Дипфейк что это значит

Дипфейки: дезинформация или шаг в будущее?

Фейки на выборах и «воскрешение» из мертвых

Совсем недавно, на рубеже XX и XXI веков, сверхпопулярной была программа Photoshop. Теперь на смену ей пришли нейросети, а именно дипфейки (Deepfake). Эта технология куда опаснее, но также перспективнее прежней возможности грубо вырезать лица людей с фотографий и приклеивать их на другие снимки.

Другая история произошла в 2020 году на выборах в Индии. В Дели лидер одной из оппозиционных партий Маноджа Тивари сделал заявление на хинди и на диалекте хариани. При этом говорить на этом языке он не умел. Пойти на обман Маноджа Тивари решился скорее всего из-за желания завоевать голоса рабочих-мигрантов в Дели. Они как раз говорят на диалекте хариани.

И подобных случаев уже много. В истории с лидером индийской оппозиции интересно то, что он так и не признался в использовании технологии: доказать это довольно сложно, вот и признаваться необязательно.

Еще один пример — фильм «Би-би-си» «Добро пожаловать в Чечню» про активистов, критикующих власть. Создатели картины не стали «замазывать» лица оппозиционеров, а наложили на них дипфейки активистов, живущих в Нью-Йорке.

Можно ли вычислить дипфейки

Сложность в борьбе с нечестным использованием технологии заключается в том, что подделки будут становиться только качественнее.

Дипфейк — это генеративно-состязательная сеть. В ней есть генератор и дискриминатор. Генератор создает подделку, а дискриминатор критикует и указывает на ее недостатки. После этих замечаний генератор снова приступает к работе. В итоге появляется очень точный фейк.

Некоторые страны приняли решение регулировать дипфейки законом.

В 2020 году Калифорнийский и Стэндфордский университеты смогли повысить точность выявления дипфейков до 97%. Ученые исследовали виземы и фонемы.

Виземы — визуальное выражение того, как произносится тот или иной звук. Условно — мы говорим что-то и наш рот как-то движется. Филологи пытаются сравнить виземы в дипфейках и в оригинальных видео. Действительно, виземы в дипфейках выглядят немного иначе. Если обучить алгоритмы на таком поле данных, точность распознавания подделки будет достаточно высокая.

Другой способ вычисления обмана — изучение того, как шумит реальное и поддельное видео. Шум в дипфейках немного другой, и часто это удается услышать.

Другая сторона дипфейков

С помощью генеративных нейронных сетей можно создавать контент, используя минимальное количество данных. С этой точки зрения технология связана совсем не с «пересадкой» лиц для веселья, а с практической целью. Сейчас по одной фотографии и тексту возможно генерировать видео. Текст синтезируется в аудио, по аудио анимируются фотографии — в итоге мы получаем говорящего спикера. С помощью этого комплекса алгоритмов можно очень быстро создавать видеоконтент.

Дипфейки могут «воскрешать» любимых актеров. Например, Филип Сеймур Хоффман и Пол Уокер, умершие во время съемок фильмов с их участием («Голодные игры: Сойка-пересмешница» и «Форсаж 7» соответственно), были воссозданы в цифровом виде. А Кэрри Фишер «воскресили» для съемок в девятом эпизоде «Звездных войн».

Мария Чмир, гендиректор Deepcake.io, утверждает, что скоро появится инструмент, который полностью изменит интерактивность. Сегодня все, что дают зрителям, — это выбрать концовку сериала. В будущем с помощью дипфейков мы сможем оказаться внутри киновселенной вместе со своими друзьями. Будет возможность и менять надоевших актеров. Ведь генеративные нейросети позволяют существенным образом редактировать, видоизменять и трансформировать контент.

Именно поэтому дипфейки — это не только манипуляция и дезинформация. С помощью них можно будет снимать фильмы со спецэффектами, оживлять персонажей и в целом добавить новый опыт потребления контента.

Вооруженный глаз: как распознать дипфейк

Дипфейки — это видеоролики, в которых одно лицо подменяется другим с помощью алгоритмов машинного обучения. Если несколько лет назад подобные имитации были довольно топорными и вызывали большей частью смех, то сегодня технология качественно эволюционировала. И, как это часто бывает с новинками, немедленно была взята на вооружение криминалом. Сгенерированный компьютером голос начальника просит сотрудника перевести крупную сумму, а звезд шоу-бизнеса и политиков терроризируют фальшивыми порнороликами с их участием. Эксперты прогнозируют, что по мере сбора биометрических данных риск мошенничества возрастает. Как распознать дипфейк и какие меры вводятся для борьбы с подобного рода манипуляциями — в материале «Известий».

Кейдж и обнаженка

Считается, что первые дипфейки появились в конце 2017 года, когда пользователь Deepfakes выложил на Reddit порнографические ролики, в которых лица актеров были заменены на лица голливудских звезд. Технология разошлась по Сети и породила массу подобного контента. Чуть позже, наигравшись с роликами для взрослых, пользователи взялись за Николаса Кейджа. С помощью приложения FakeApp, запущенного в январе 2018-го, американский актер был помещен в фильмы, в которых никогда не принимал участия. А несовершенность технологии только прибавила видео веселости.

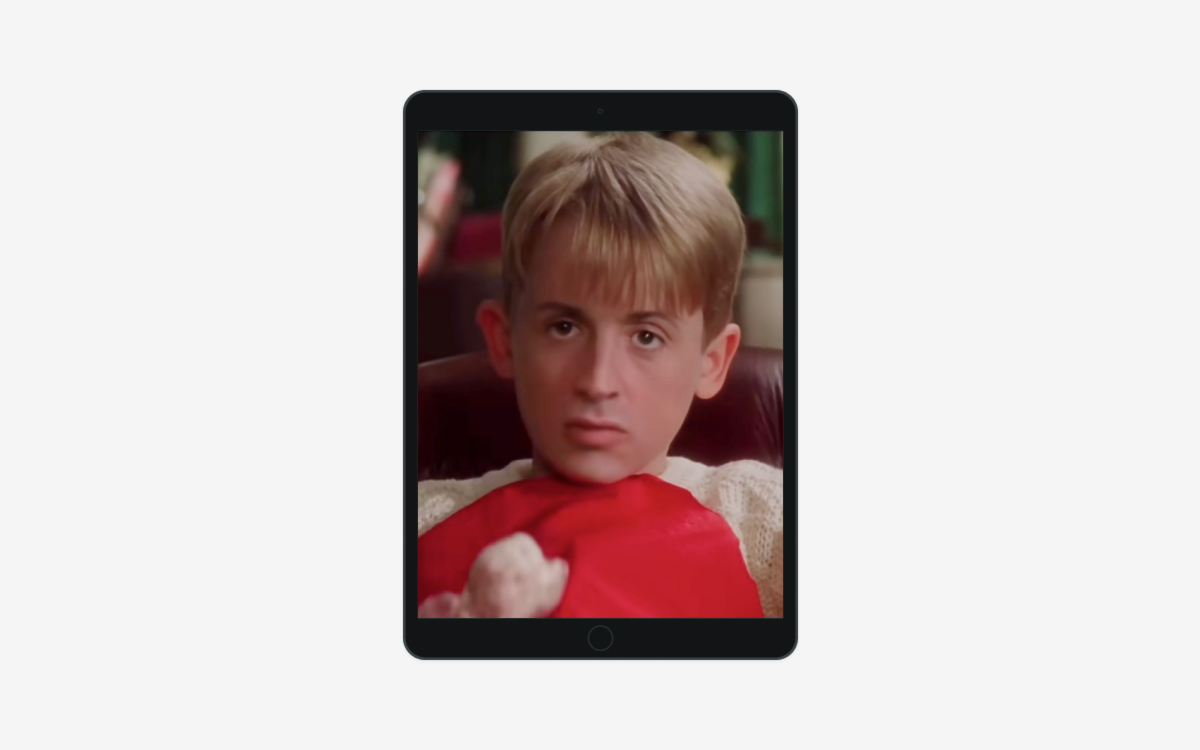

В дальнейшем опыты стали более разнообразными: Сильвестр Сталлоне «превратился» в мальчика Кевина из фильма «Один дома», Арнольд Шварценеггер «сыграл» всех персонажей во «Властелине колец», а Илон Маск «исполнил» песню «Трава у дома».

Между дипфейками есть свои различия. Наверняка многие встречали видео, на которых пользователи «примеряют маску» знаменитых политиков, дарят им свою артикуляцию и заставляют говорить странные вещи. Данный метод называется Face2Face. Подделка создается в режиме реального времени и в отличие от собственно DeepFake не подменяет одно лицо другим, а искажает мимику исходного объекта.

Однако в последние годы термин deepfake используется в широком смысле — им обозначают все типы имитирующих видео, созданных искусственным интеллектом.

Механизм работы

Дипфейки создаются при помощи метода глубокого обучения, известного как генеративно-состязательная сеть (GAN). Его суть заключается в соревновании двух нейросетей: генератора и дискриминатора. Генератор создает подделку, а дискриминатор пытается понять, настоящее перед ним изображение или нет. Чем лучше обманывает генератор, тем выше конечный результат.

Прежде созданные GAN изображения отличались довольно низким разрешением. По размытости картинки можно было легко идентифицировать запись как сгенерированную. Это ограничение было преодолено в версии ProGAN, благодаря которой разрешение подскочило до 1024×1024 пикселей.

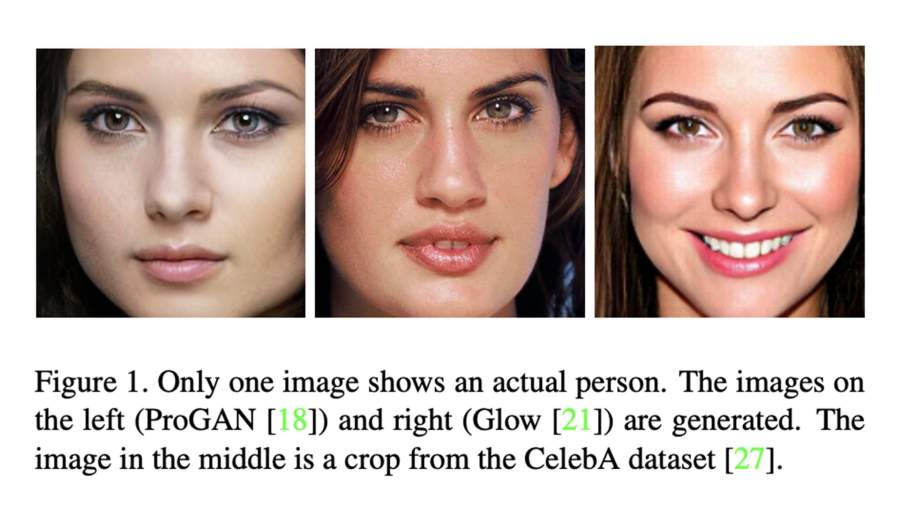

Другая модель — StyleGAN — научилась мастерски создавать лица несуществующих людей. Нейросеть обучилась на библиотеке реальных фотопортретов и стала сама генерировать человеческие образы.

Насколько высоки результаты в генерации новых лиц, можно убедиться на примере картинки ниже. Только на одной из трех фотографий изображена реальная девушка. Она посередине.

Как распознать подделку?

Точность и высокое качество дипфейков вызвали рост недоверия пользователей Сети к видеоконтенту. Однако при более внимательном рассмотрении в некоторых роликах заметны цифровые артефакты — недостатки, которые выдают имитацию. Для обоих поколений дипфейков (ранних недостаточно реалистичных и поздних гиперреалистичных) выявление артефактов происходит по одним и тем же участкам лица. Ученые из Университета Эрлангена–Нюрнберга описали возможные ограничения в своей статье.

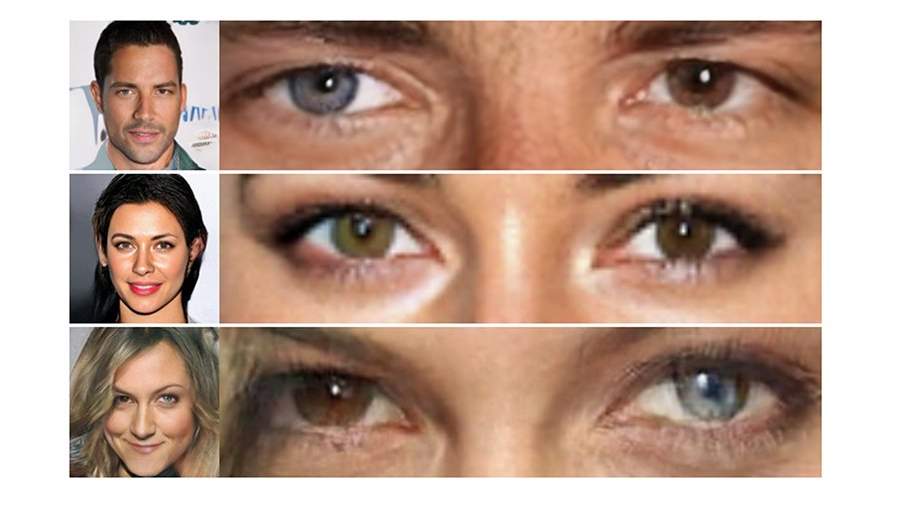

Несуществующие лица. Часто у сгенерированных моделей не совпадает цвет левого и правого глаза. В природе явление гетерохромии встречается весьма редко, поэтому смешанные или отличающиеся цвета могут стать сигналом для опознания дипфейка. Также стоит иметь в виду, что расстояние от центра глаза до края радужной оболочки должно быть одинаковым для обоих глаз. Кроме того, ожидается, что оба лимба будут иметь правильный округлый контур. Обнаруженные артефакты проиллюстрированы на картинках ниже.

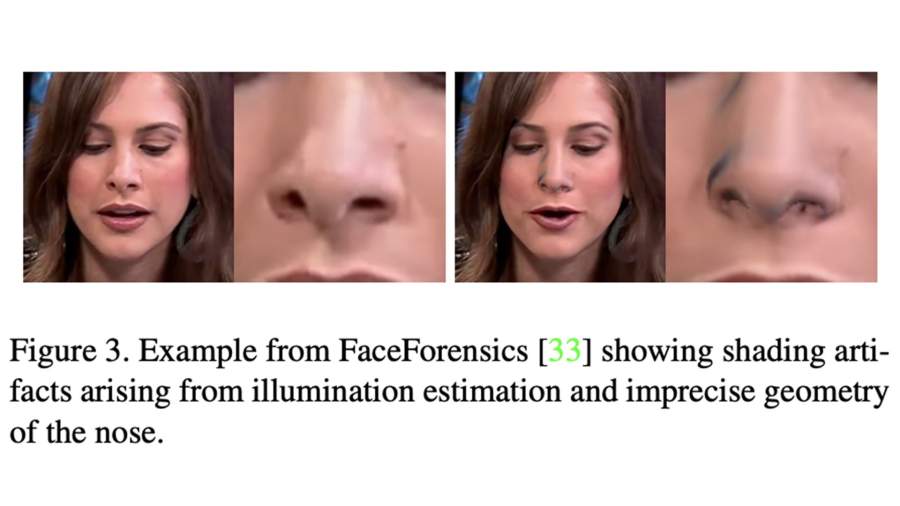

Face2Face. Для данного метода будут показательны границы лица и кончик носа. Неточное наложение маски приводит к артефактам затемнения, когда, например, одна сторона носа может казаться темнее другой. При этом контуры маски резко отделяются: это хорошо видно внизу лица и над бровями. Элементы, которые частично закрывают части лица (например, пряди волос), моделируются неправильно и могут привести к образованию «дыр».

DeepFake. Для дипфейков наиболее уязвимыми считаются глаза и зубы. Многие образцы имеют неубедительные зеркальные отражения — блики в глазах либо отсутствуют, либо кажутся упрощенными. Этот артефакт делает глаза тусклыми. Другой минус — непрорисованные зубы. Бывает, они вообще не моделируются, а выглядят как отдельное белое пятно.

6 лучших Deepfake приложений и инструментов в 2021 году

Различные методы манипулирования изображениями были введены в 19 веке и позднее применялись к кинофильмам. Эти методы быстро улучшились с цифровым видео.

В начале 1990-х годов исследователи из академических институтов разработали технологию Deepfake, которая впоследствии была доработана разработчиками в онлайн-сообществах. В последнее время подделки Deepfake привлекают большое внимание за их использование в финансовых махинациях, розыгрышах и фальшивых новостях.

Это заставило правительство и промышленность выявлять и ограничивать их незаконное использование. Тем не менее технология имеет большой потенциал, если ее правильно использовать.

Что такое технология Deepfake?

Deepfakes относятся к манипулируемому визуальному контенту, генерируемому сложным искусственным интеллектом, который дает сфабрикованные изображения и звуки, которые кажутся реальными. В большинстве случаев, человек в существующем видео или изображении заменяется на чье-то подобие.

Хотя трудно создать хороший deepfake на обычном компьютере, есть много инструментов, доступных в интернете, чтобы помочь людям сделать достойные deepfakes. Технология все еще находится в зачаточном состоянии, поэтому не ожидайте идеального результата.

Мы тщательно собрали несколько хороших deepfake приложений и инструментов, которые не требуют высокого класса рабочего стола с мощными графическими картами (за исключением одного или двух). Вы можете использовать их как в исследовательских целях, так и просто для развлечения, но не нарушайте чью-либо частную жизнь.

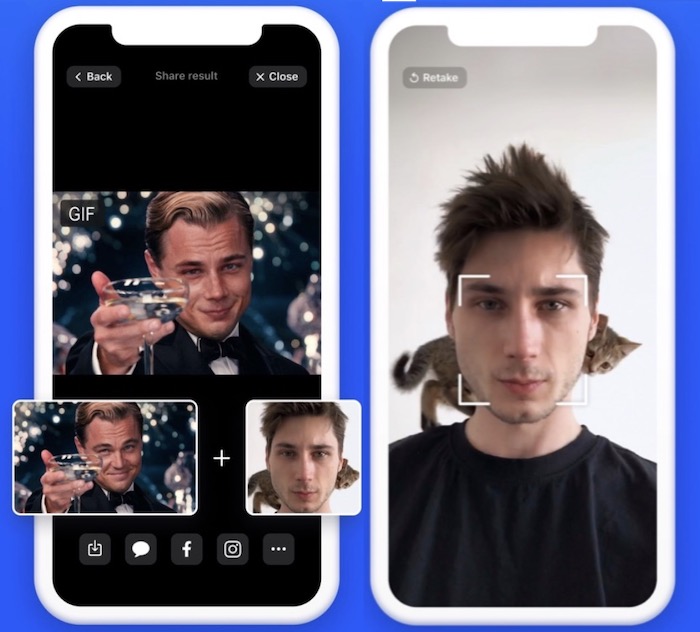

6. Doublicat

Платформа: Android / iOS

Цена: Бесплатно

Doublicat позволяет вам сделать селфи и поместить свое лицо на мем или GIF в своей библиотеке. Это займет около 5 секунд, чтобы ваше лицо было наложено на лицо Брэда Питта, Леонардо Ди Каприо или Тейлора Свифта.

Вы будете удивлены, увидев, насколько хорошо ваше наложенное лицо принимает те же выражения, что и оригинал. Вы можете переслать результаты своей семье и друзьям или опубликовать их в Instagram.

Вывод будет довольно странным, если будет много движений лица, но в целом это интересный эксперимент. По словам разработчиков приложения, само изображение удаляется с серверов сразу после его обработки. Однако при этом сохраняется представление черт лица.

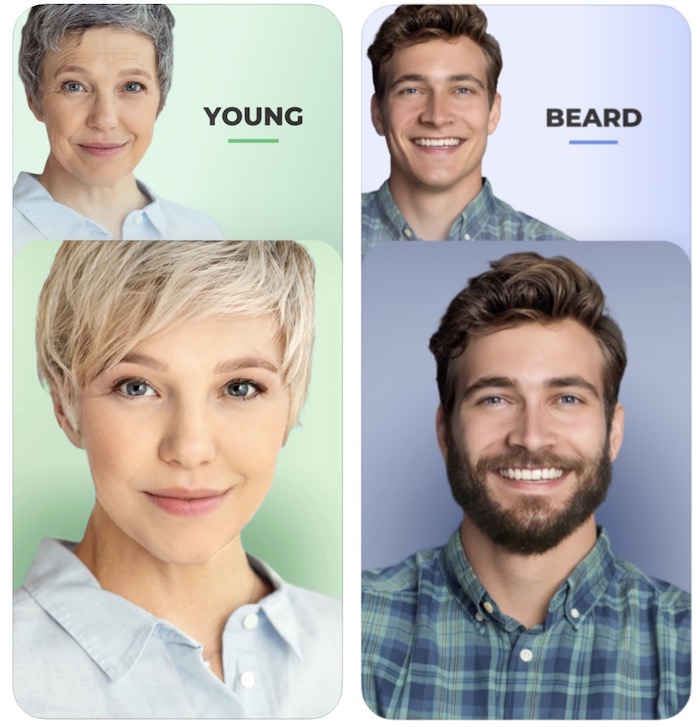

5. FaceApp

Платформа: Android / iOS

Цена: Бесплатно

FaceApp разработан российской компанией Wireless Lab. Он использует нейронные сети для генерации высокореалистичных преобразований лиц на фотографиях.

Приложение может преобразить ваше лицо, чтобы заставить его улыбаться, выглядеть старше, выглядеть моложе или просто смены пола, а также многих других захватывающих преобразований. Татуировки, виньетки, размытие объектива и наложение фона также являются частью FaceApp.

В 2018 году приложение привлекло много внимания со стороны трансгендерных и ЛГБТ-сообществ из-за его реалистичных преобразований гендерных изменений. Он также столкнулся с критикой как в социальных сетях, так и в прессе за конфиденциальность пользовательских данных.

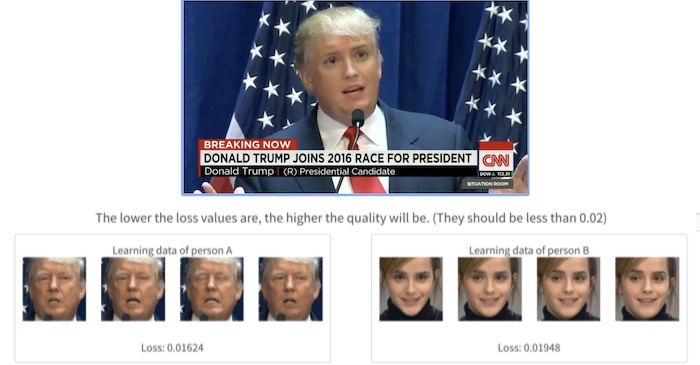

4. Deepfakes web β

С помощью этого инструмента вы можете создавать deepfake видео в интернете. Однако кривая обучения здесь немного больше, чем то, что вы найдете в других приложениях.

Вам нужно зарегистрироваться и загрузить свои видео. Все остальное происходит в облаке, где используются мощные графические процессоры. На изучение видео/изображений и смену лиц уходит почти 4 часа. Вы также можете использовать обученную модель, чтобы менять лица, что занимает около 30 минут.

Качество выходного видео зависит от значений «потерь»: чем ниже значения потерь (при обучении из загруженных видео), тем выше качество. И, конечно, только вы можете получить доступ к своим видео и учебным данным.

3. DeepFaceLab

Платформа: Windows

Цена: Бесплатный

DeepFaceLab является ведущим программным обеспечением для создания подделок. Она использует новые нейронные сети для замены лиц в видео. Она размещена на GitHub и породила бесчисленное множество видео в интернете.

По словам его разработчиков, более 95% глубоких подделок видео создаются с помощью DeepFaceLab. Его используют несколько популярных каналов YouTube, таких, как Ctrl Shift Face, iFake и Shamook.

DeepFaceLab прекрасно работает, но для его использования необходимы технические знания. Как только вы загрузите и разархивируете инструмент, вы увидите множество папок и ряд командных файлов. Существует папка с именем «workspace», которая содержит все обучающие модели, исходные видео и выходные данные. Инструмент работает с определенными именами и местоположениями файлов, чтобы пакетный файл мог функционировать.

2. FaceSwap

Платформа: Windows | MacOS | Linux

Цена: бесплатно

FaceSwap похож на DeepFaceLab, но предоставляет больше возможностей, лучшую документацию и лучшую онлайн-поддержку. И да, он также доступен на Mac и Linux.

Это инструмент с открытым исходным кодом, наполненный функциональностью для выполнения каждого шага процесса Deepfake, от импорта первоначального видео до создания финального видео Deepfake. Чтобы запустить этот инструмент, вам нужна мощная видеокарта, так как замена лица происходит невероятно медленно.

Работая на Python, Keras и Tensorflow, Faceswap имеет активное сообщество, поддерживающее и разрабатывающее программное обеспечение. Есть много учебников, которые помогут вам начать работу.

1. Zao

Платформа: Android | iOS

Цена: бесплатно

Технология глубокой подделки Zao позволяет вам модулировать голоса знаменитостей и накладывать свое лицо на тело актера в сцене.

Просто нажмите на одну фотографию и попробуйте тысячи модных причесок, одежды и макияжа. Приложение предоставляет вам множество видеоклипов, нарядов и буквально неограниченные возможности для изучения.

В 2019 году Zao за короткое время приобрел значительную популярность, позволив пользователям обмениваться лицами с любимыми актерами в коротких клипах из телепередач и фильмов. За месяц он стал самым загружаемым бесплатным приложением в Китае. С ростом популярности, его разработчики также столкнулись с критикой политики конфиденциальности приложения.

Это займет всего несколько секунд, чтобы поменять ваше лицо, но так как алгоритм в основном обучен на китайских лицах, это может выглядеть не так естественно, как вы ожидаете.

Тем не менее все эти инструменты демонстрируют, как быстро развивался базовый ИИ: то, что раньше требовало тысячи картинок, чтобы сделать достаточно убедительное глубокое поддельное видео, теперь требует только одного изображения и дает лучшие результаты.

Дипфейки: как трансформируется авторское право на контент

Массовый дипфейк: тренд на синтетический контент

Технологии дипфейков развиваются быстрее, чем технологии их обнаружения и законодательная база для регулирования их создания. ИИ скоро достигнет точки, когда будет практически невозможно отличить аудио и видео людей, говорящих то, что они никогда не говорили.

Дипфейк (из двух английских слов «deep learning — глубокое обучение» и «fake — подделка») — это синтетический контент, в котором человек в существующем фото, аудио или видео заменяется на другого. Дипфейки могут использовать любой формат — ваше фото, видео или ваш голос. Дипфейки наиболее часто используют в рекламе, порнофильмах, порномести, фейковых новостях и для финансового мошенничества.

Технология дипфейков — это не абсолютное зло, она может революционно изменить, например, киноиндустрию. С помощью нее можно искусственно омолодить или состарить актеров, придать дублерам большее сходство с актерами, синхронизировать движения губ при дубляже перевода или даже доснять фильм с изображением внезапно умершего или переставшего участвовать в съемках актера. Как правило, применение таких технологий юридически невозможно без согласия актеров, чьи изображения будут использованы в конечном материале, либо их наследников, если человек уже умер.

«В мире уже много проектов коммерческого использования дипфейков (Synthesia, WPP, Rosebud, Rephrase.ai, Canny AI). Технология дипфейков открывает возможность создавать полностью синтетические личности — изображения и голоса людей, которых никогда не существовало. Использование таких изображений практически полностью снимает зависимость бизнеса от моделей и актеров, в том числе от необходимости «очистки» авторских и смежных прав и подписания различных релизов», — считает Вадим Перевалов, старший юрист международной юридической фирмы Baker McKenzie.

Аудиофейки: есть ли авторское право на голос?

Голосовые дипфейки представляют собой самую большую проблему, потому что на голос человека не распространяется право собственности ни в одной стране мира — если только имя человека не зарегистрировано как коммерческий бренд.

Однако в 2020 году был создан прецедент. YouTube-канал Vocal Synthesis делает юмористические дипфейки с использованием голосов политиков и знаменитостей. Команда канала в юмористической манере разместила несколько сгенерированных записей начитки текстов американской рэп-звезды Jay-Z без коммерческой выгоды, четко обозначив все видео как синтез речи.

Тем не менее, концертная компания RocNation, которая принадлежит Jay-Z, подала иск о нарушении авторских прав. Организация выдвинула требование удалить видео, где, по их мнению, незаконно использован ИИ для имитации голоса музыканта.

Только два из четырех видео Jay-Z были удалены — было признано, что полученный в результате звуковой продукт является производной работой, не имеющей ничего общего ни с одной из песен рэпера. В США не каждый случай коммерческого использования чужого голоса является нарушением закона.

«Перспективное направление дипфейков — использование изображений или голосов знаменитостей для производства контента без их участия. Например, в России использование чужой речи для создания «похожего» голоса в явном виде не запрещено законодательством. Имитация голоса, например, телефонными пранкерами, тоже не является нарушением и, скорее, зависит от содержания шутки, которая может попасть под уголовную ответственность. А использование технологий дипфейка в рекламе не должно вводить потребителей в заблуждение — например, о том, что известная личность якобы рекомендует какой-либо товар. Помимо этого, остается дискуссионным вопрос, не нарушит ли создание такого «голосового слепка» авторские и смежные права на фонограммы и актерское исполнение», — поделился мнением Вадим Перевалов.

В марте 2019 года в Великобритании произошел инцидент с аудиофейком — ПО на основе искусственного интеллекта было использовано, чтобы сымитировать голос исполнительного директора британской энергетической компании и дать сотруднику этого предприятия поручение о переводе третьим лицам €220 тыс. Работник подумал, что разговаривает по телефону со своим боссом, и отправил деньги мошенникам. Следователи так и не установили подозреваемых.

Защита авторского права исходников дипфейков

Основная проблема в отношении дипфейков — еще ни в одной стране мира не создано законодательной практики, которая могла бы повлиять как на создателей дипфейков, так и на процедуру по их удалению. Закон об авторском праве может действовать как эффективное средство регулирования дипфейков, но для этого его надо доработать. Вопрос защиты прав умерших (например, киноактеров) в отношении использования их голоса и образа остается также открытым.

Вероятно, в российском законодательстве дипфейки стоит рассматривать через призму производного произведения, при котором использование исходного произведения без согласия его правообладателя будет незаконно.

«Исключительное право на результат интеллектуальной деятельности возникает изначально у автора (соавторов), а потом может быть передано автором другому лицу по договору (ст. 1228 ГК РФ). Российское законодательство также предусматривает, что для возникновения, осуществления и защиты авторских прав не требуется регистрации или соблюдения каких-либо формальностей. Это главный подход для современной международной системы охраны авторских прав, предусматривающей также возможность подтверждения авторства с помощью презумпции авторства (статья 15 Бернской конвенции об охране литературных и художественных произведений), » — утверждает Дмитрий Игнатенко, руководитель юридической службы компании Rubytech.

Если рассматривать право авторства на дипфейк как результат интеллектуальной деятельности, созданной программой, то по российскому законодательству автором может быть только гражданин, творческим трудом которого создан этот результат (ст. 1228 ГК РФ). А правообладателем может быть лишь человек или юридическое лицо, обладающие исключительным правом на результат интеллектуальной деятельности или на средство индивидуализации (ст. 1229 ГК РФ). Так что за любой машиной должно стоять физическое или юридическое лицо, в противном случае не будет создан объект авторского права.

Технологии совершенствования дипфейков развиваются быстрее, чем законы в этой области. Американские Twitter, Facebook и китайский TikTok попытались самостоятельно отрегулировать распространение дипфейков разными способами

Twitter ввел правила по дипфейкам и манипулированию СМИ, которые в основном предусматривают пометку твитов и предупреждение пользователей об измененных новостях, а не их удаление. По заявлению компании, твиты, содержащие фальсифицированные или недостоверные материалы, будут удаляться только в том случае, если они могут причинить вред. В определение вреда также включены любые угрозы конфиденциальности или праву человека или группы лиц свободно выражать свое мнение. Это означает, что политика распространяется на преследование, навязчивое внимание, подавление или запугивание избирателей, а также на контент, содержащий фразы, предназначенные для того, чтобы заставить кого-то замолчать.

Facebook в начале 2020 года анонсировал политику для удаления дипфейков. Сообщения будут удалены, если они соответствуют таким критериям:

TikTok. Новая политика TikTok запрещает любой синтетический или манипулирующий контент, который вводит пользователей в заблуждение, искажая правду о событиях, и который влечет причинение вреда. Политика не столько запрещает конкретную технологию, основанную на ИИ, сколько призвана в большей степени предупредить использование любого вида обманного видео для очернения политических оппонентов в интернете.

Основной проблемой для соцсетей являлось отсутствие технологии обнаружения дипфейков. В 2019 году Facebook вместе с Microsoft и другими партнерами запустили конкурс для решения проблемы обнаружения The Deepfake Detection Challenge. Самой успешной стала модель белорусского разработчика Селима Сефербекова. Она достигла точности 65,18% на тестовых дата-сетах. На третьем месте — модель российской компании NTechLab.

Технологические лидеры — «Яндекс», TikTok, Microsoft, IBM, Kaspersky Lab, Reface, FaceApp, Ntechlab, и др. отказались комментировать РБК тренды дипфейков и авторского права.

Подписывайтесь также на Telegram-канал РБК Тренды и будьте в курсе актуальных тенденций и прогнозов о будущем технологий, эко-номики, образования и инноваций.