Что такое дип фейки

Дипфейки: что это за технология и почему она опасна

Слово deepfake появилось несколько лет назад. Оно объединяет в себе два понятия: глубокое обучение (deep learning), то есть обучение нейросетей, и подделку (fake). Технология дипфейков заключается в синтезе ИИ человеческих изображений: алгоритм объединяет несколько фото, на которых человек изображен с разным выражением лица, и делает из них видео. При этом ИИ анализирует большое количество снимков и учится тому, как может выглядеть и двигаться конкретный человек. Об этом пишет американское издание Forbes.

С распространением дипфейков появились случаи «дискредитации» публичных личностей, чьих изображений много в открытом доступе. Например, весной 2019 года в Сети было опубликовано дипфейк-видео со спикером палаты представителей конгресса США Нэнси Пелоси. Автор ролика с помощью ИИ изменил речь Пелоси так, что она плохо выговаривала слова, и пользователи, посмотревшие видео, посчитали, что политик пьяна. Ситуация вылилась в громкий скандал, и лишь спустя некоторое время было доказано, что речь Пелоси была сгенерирована ИИ.

Этот дипфейк был сделан достаточно просто. Но есть и сложные алгоритмы. Они не просто меняют тембр голоса или замедляют речь, а генерируют такие видео, на которых человек делает то, чего никогда не совершал, или говорит то, чего никогда не говорил. Со временем дипфейки будут становиться все более реалистичными, пишет американское издание Forbes. Уже сейчас технология претендует на то, чтобы влиять на политику, а в дальнейшем такие видео и вовсе смогут стать угрозой национальной безопасности.

Что такое deepfake и чем опасна эта технология?

IT-компания DAR и Informburo.kz в проекте “Понятно о технологиях” – о том, что такое deepfake и как отличить поддельные фотографии и видео от настоящих.

Помните сцену из легендарного фильма Стэнли Кубрика «Сияние», когда обезумевший писатель Джек Торренс (Джек Николсон), прорубает топором дверь, пытаясь попасть в ванную, где спрятались его сын и жена? Он просовывает голову внутрь и, скалясь, кричит: «А вот и Джонни!».

Сцена из фильма стала культовой, а пару месяцев назад в сети появились ролики, где вместо лица Николсона при помощи алгоритма машинного обучения было «подрисовано» лицо Джима Керри. Актёр двигался, разговаривал и точь-в-точь повторял мимику персонажа Николсона.

Подмена лиц в видео быстро набрала обороты и получила название deepfake (конкатенация слов «глубинное обучение» (англ. Deep learning) и «подделка» (англ. Fake). И технология так и осталась бы забавой, но вскоре в Сети стали появляться ролики с политиками. Как оказалось, чехарда с «подрисовыванием» лиц представляет куда большую угрозу, ведь злоумышленники вполне могут использовать такой подход в информационных войнах или мести, тем более что отличить deep fakes от реальной картинки становится все сложнее.

Что такое deepfake?

Искусственный интеллект deepfake использует синтез человеческого изображения – объединяет несколько картинок, на которых человек запечатлен с разных ракурсов и с разным выражением лица, и делает из них видео. Анализируя фотографии, специальный алгоритм «учится» тому, как выглядит и может двигаться человек.

Работают две нейросети. Первая генерирует образцы изображения, а вторая отвечает за то, чтобы отличать настоящие образцы от поддельных. Технологию можно сравнить с работой двух фальшивомонетчиков, один из которых подделывает купюры, а второй пытается отличить эти подделки от оригиналов. В случае если второй обнаруживает подделку, изображение отсылается первому, который улучшает свою работу, предлагая более реалистичную подделку.

Сервисы deepfake работают при помощи открытых алгоритмов машинного обучения и библиотек, за счёт чего нейросеть может не только обучиться, но и достичь «почти человеческого» качества. Нейросеть получает изображения из библиотеки и «учится» при помощи роликов на том же YouTube. Искусственный интеллект тем временем сопоставляет фрагменты исходных портретов с тем, что есть на видео, и в итоге мы получаем максимально правдоподобную картинку.

Публикация от Илона Нейро ТП (@neural_tp) 25 Авг 2019 в 9:27 PDT

Поддельные видеоролики стали появляться в 2017-м году, когда один из пользователей социального сервиса Reddit с ником Deepfakes разместил у себя на страничке видео для взрослых, где вместо настоящего лица актрисы было «подрисовано» лицо исполнительницы роли Чудо-женщины Галь Гадот. Позже подобная технология также была использована для ролика, где экс-президент США Барак Обама нецензурно выражался и оскорблял Дональда Трампа. Лицо экс-президента просто наложили на лицо актёра Джордана Пила. Получилось правдоподобно.

В чём тут опасность?

С распространением deep fake появилась опасность дискредитации любого пользователя, фото которого есть в сети. Первыми под огонь попали публичные личности, изображений которых достаточно много в открытом доступе. Например, лицо актера Николаса Кейджа давно стало мемом, а сам он известен неразборчивостью в выборе ролей. Благодаря deep fake лицо Николаса Кейджа поместили практически во все эпизоды известных фильмов. Например, он стал Лоис Лейн из «Человека из стали»:

Учитывая количество фото, которые мы заливаем в социальные сети, недостатка в материале для deep fake нет. Проблема в том, что в будущем пользователи, которые не смогут доказать, что их не было на определённом видео, может, например, грозить тюремный срок.

По мнению Адиля Жалилова, руководителя factсheck.kz, в зависимости от контента такие видео могут быть как безобидными, так катастрофически опасными.

«Предположим, что, учитывая напряжённые отношения между этносами, религиозными группами, кто-то зальет в социальные сети видео, где представитель той или иной группы высказывает оскорбительные мнения или осуществляет действия, которые могут быть восприняты как оскорбление», – говорит он.

По его словам, если население будет не в курсе о возможностях и вообще о существовании deep fakes, то любое такое поддельное видео с провокационным контентом может «вложить в уста» любому политику или представителю какого-либо этноса любой месседж. Это может породить деструктивный импульс и спровоцировать конфликты. Любая попытка властей реагировать, объяснить технологию deep fakes постфактум будет запоздалой в такой ситуации.

Можно ли распознать deepfake?

Видео с применением deepfake выглядят убедительно только в течение пары-тройки секунд, но они (во всяком случае, пока) далеки от того, чтобы обмануть пользователей.

Если присмотреться к таким роликам внимательней, то можно заметить, что, например, «подрисованные» лица на видео не моргают.

Эффект постоянно открытых глаз связан с недостатками процесса создания таких роликов. Дело в том, что среди картинок, по которым обычно учится нейросеть, не так много (на самом деле их нет вообще) фотографий с закрытыми глазами. Пользователи вряд ли хранят или выкладывают в сеть неудачные селфи, на которых они моргают.

Адиль Жалилов отмечает, что в перспективе распознавать deep fakes можно будет путём анализа движения глаз и амплитуды моргания.

«Предполагаю, что найдутся и другие методы распознавания поддельных видео. И очень важно, чтобы эти методы были простыми и прикладными, доступными для общества. Также важно всем государствам активно развивать и поддерживать фактчекинг, специализирующийся на борьбе с дезинформацией, а также медиаграмотность, куда включать обучение всего населения в том числе по распознаванию поддельных изображений и видео», – говорит Жалилов.

Чтобы распознать deepfake, учёные из Университета Олбани провели эксперимент, в котором выявили, что в среднем люди моргают 17 раз в минуту. Эта цифра увеличивается до 26 раз во время разговора, и падает до 4,5 раз во время чтения. Эти же учёные предложили свой метод распознавания фейковых видеороликов, объединив две нейронные сети, для того чтобы более эффективно распознавать ненастоящие лица. Как выяснилось, нейронные сети часто упускают спонтанные и непроизвольные физиологические действия. Например, дыхание во время речи или движение глаз.

«Так как многие из политиков, вероятно, читают текст своей речи, когда их снимают. Когда спикер на видео не моргает вообще, легко определить, что такие кадры являются фейком», – говорит профессор Люй, возглавивший исследование Университета Олбани.

Профессор отмечает, что стандарты проверки доказательств deep fake должны развиваться параллельно улучшению поддельных видео, иначе однажды мы вообще не сможем доверять видеоконтенту.

6 лучших Deepfake приложений и инструментов

Различные методы манипулирования изображениями были введены в 19 веке и позднее применялись к кинофильмам. Эти методы быстро улучшились с цифровым видео.

В начале 1990-х годов исследователи из академических институтов разработали технологию Deepfake, которая впоследствии была доработана разработчиками в онлайн-сообществах. В последнее время подделки Deepfake привлекают большое внимание за их использование в финансовых махинациях, розыгрышах и фальшивых новостях.

Это заставило правительство и промышленность выявлять и ограничивать их незаконное использование. Тем не менее технология имеет большой потенциал, если ее правильно использовать.

Что такое технология Deepfake?

Deepfakes относятся к манипулируемому визуальному контенту, генерируемому сложным искусственным интеллектом, который дает сфабрикованные изображения и звуки, которые кажутся реальными. В большинстве случаев, человек в существующем видео или изображении заменяется на чье-то подобие.

Хотя трудно создать хороший deepfake на обычном компьютере, есть много инструментов, доступных в интернете, чтобы помочь людям сделать достойные deepfakes. Технология все еще находится в зачаточном состоянии, поэтому не ожидайте идеального результата.

Мы тщательно собрали несколько хороших deepfake приложений и инструментов, которые не требуют высокого класса рабочего стола с мощными графическими картами (за исключением одного или двух). Вы можете использовать их как в исследовательских целях, так и просто для развлечения, но не нарушайте чью-либо частную жизнь.

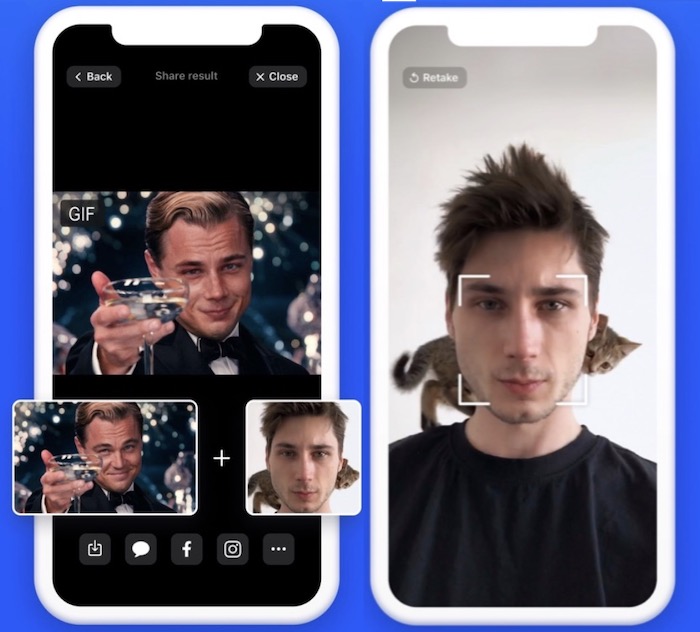

6. Doublicat

Платформа: Android / iOS

Цена: Бесплатно

Doublicat позволяет вам сделать селфи и поместить свое лицо на мем или GIF в своей библиотеке. Это займет около 5 секунд, чтобы ваше лицо было наложено на лицо Брэда Питта, Леонардо Ди Каприо или Тейлора Свифта.

Вы будете удивлены, увидев, насколько хорошо ваше наложенное лицо принимает те же выражения, что и оригинал. Вы можете переслать результаты своей семье и друзьям или опубликовать их в Instagram.

Вывод будет довольно странным, если будет много движений лица, но в целом это интересный эксперимент. По словам разработчиков приложения, само изображение удаляется с серверов сразу после его обработки. Однако при этом сохраняется представление черт лица.

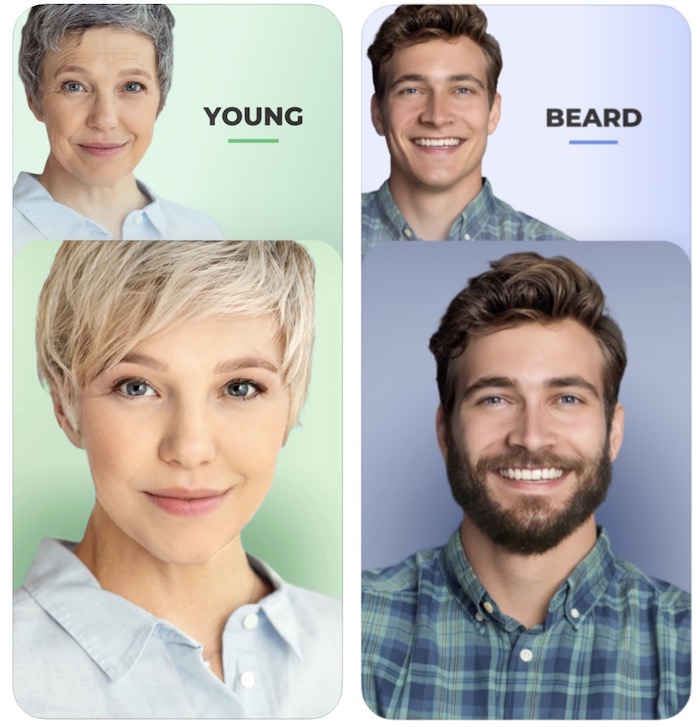

5. FaceApp

Платформа: Android / iOS

Цена: Бесплатно

FaceApp разработан российской компанией Wireless Lab. Он использует нейронные сети для генерации высокореалистичных преобразований лиц на фотографиях.

Приложение может преобразить ваше лицо, чтобы заставить его улыбаться, выглядеть старше, выглядеть моложе или просто смены пола, а также многих других захватывающих преобразований. Татуировки, виньетки, размытие объектива и наложение фона также являются частью FaceApp.

В 2018 году приложение привлекло много внимания со стороны трансгендерных и ЛГБТ-сообществ из-за его реалистичных преобразований гендерных изменений. Он также столкнулся с критикой как в социальных сетях, так и в прессе за конфиденциальность пользовательских данных.

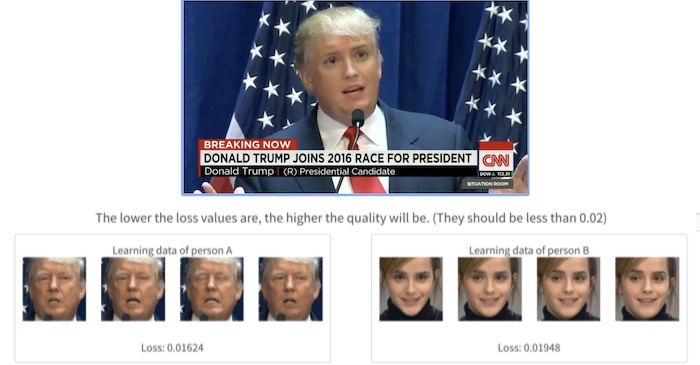

4. Deepfakes web β

С помощью этого инструмента вы можете создавать deepfake видео в интернете. Однако кривая обучения здесь немного больше, чем то, что вы найдете в других приложениях.

Вам нужно зарегистрироваться и загрузить свои видео. Все остальное происходит в облаке, где используются мощные графические процессоры. На изучение видео/изображений и смену лиц уходит почти 4 часа. Вы также можете использовать обученную модель, чтобы менять лица, что занимает около 30 минут.

Качество выходного видео зависит от значений «потерь»: чем ниже значения потерь (при обучении из загруженных видео), тем выше качество. И, конечно, только вы можете получить доступ к своим видео и учебным данным.

3. DeepFaceLab

Платформа: Windows

Цена: Бесплатный

DeepFaceLab является ведущим программным обеспечением для создания подделок. Она использует новые нейронные сети для замены лиц в видео. Она размещена на GitHub и породила бесчисленное множество видео в интернете.

По словам его разработчиков, более 95% глубоких подделок видео создаются с помощью DeepFaceLab. Его используют несколько популярных каналов YouTube, таких, как Ctrl Shift Face, iFake и Shamook.

DeepFaceLab прекрасно работает, но для его использования необходимы технические знания. Как только вы загрузите и разархивируете инструмент, вы увидите множество папок и ряд командных файлов. Существует папка с именем «workspace», которая содержит все обучающие модели, исходные видео и выходные данные. Инструмент работает с определенными именами и местоположениями файлов, чтобы пакетный файл мог функционировать.

2. FaceSwap

Платформа: Windows | MacOS | Linux

Цена: бесплатно

FaceSwap похож на DeepFaceLab, но предоставляет больше возможностей, лучшую документацию и лучшую онлайн-поддержку. И да, он также доступен на Mac и Linux.

Это инструмент с открытым исходным кодом, наполненный функциональностью для выполнения каждого шага процесса Deepfake, от импорта первоначального видео до создания финального видео Deepfake. Чтобы запустить этот инструмент, вам нужна мощная видеокарта, так как замена лица происходит невероятно медленно.

Работая на Python, Keras и Tensorflow, Faceswap имеет активное сообщество, поддерживающее и разрабатывающее программное обеспечение. Есть много учебников, которые помогут вам начать работу.

1. Zao

Платформа: Android | iOS

Цена: бесплатно

Технология глубокой подделки Zao позволяет вам модулировать голоса знаменитостей и накладывать свое лицо на тело актера в сцене.

Просто нажмите на одну фотографию и попробуйте тысячи модных причесок, одежды и макияжа. Приложение предоставляет вам множество видеоклипов, нарядов и буквально неограниченные возможности для изучения.

В 2019 году Zao за короткое время приобрел значительную популярность, позволив пользователям обмениваться лицами с любимыми актерами в коротких клипах из телепередач и фильмов. За месяц он стал самым загружаемым бесплатным приложением в Китае. С ростом популярности, его разработчики также столкнулись с критикой политики конфиденциальности приложения.

Это займет всего несколько секунд, чтобы поменять ваше лицо, но так как алгоритм в основном обучен на китайских лицах, это может выглядеть не так естественно, как вы ожидаете.

Тем не менее все эти инструменты демонстрируют, как быстро развивался базовый ИИ: то, что раньше требовало тысячи картинок, чтобы сделать достаточно убедительное глубокое поддельное видео, теперь требует только одного изображения и дает лучшие результаты.

Deepfake: краткая история появления и нюансы работы технологии

Немного истории

Технологии синтезирования видео и аудио нельзя назвать новыми. Они разрабатываются с конца 90-х годов XX века. Конечно, разные попытки делались и до этого, но мы говорим о тех технологиях, которые получили продолжение. Так, в 1997 году компания Video Rewrite представила технологию, которая позволяла сформировать видео, где артикуляция лица совпадала с синтезированной аудиодорожкой. Т.е. моделировалась артикуляционная мимика лица, которая полностью соответствовала синтезированной компьютером аудиодорожкой.

Но это были лишь первые попытки, которые активно развивались в течение двух десятков лет. Сейчас нам доступны технологии обработки голоса, объединения компьютерной графики с реальными видео и многое другое. Не везде применяется ИИ, но все же самые реалистичные системы сформированы на базе машинного обучения.

Появление «настоящих» дипфейков

Технология Deepfake упрощает процесс синтезирования изображения и создания звуковых дорожек с заданными параметрами за счет использования нейронных сетей. Они обучаются на сотнях или даже тысячах примеров лиц и голосов, с ними связанными. После этого ИИ показывает весьма впечатляющие результаты.

Нет сомнения, что с течением времени будут появляться все более реалистичные дипфейки. Уже сейчас они никого не удивляют, а в ближайшем будущем и вовсе станут привычным делом. Но кто отвечает за развитие технологий, где они используются, как работают и чего нам ожидать в будущем?

Современные игроки

Большинство крупнейших технологических игроков и развлекательных компаний активно исследуют отрасль «синтетических медиа». Amazon стремится сделать голос Алексы более реалистичным, Disney изучает, как использовать технологию смены лица в фильмах, а производители оборудования, такие как Nvidia, расширяют границы синтетических аватаров, а также услуг для кинопроизводства и телевидения.

Но есть и организации, которые создают технологии, позволяющие отличить подделку от реальности. В их число входят, например, Microsoft и DARPA.

К слову, у большинства ПО по созданию дипфейков открытый исходный код, что дает возможность работать с дипфейками даже небольшим компаниям. Проектов достаточно много. Это, например, Wombo, Аvatarify, FaceApp, Reface, MyHeritage и многие другие.

Как создаются дипфейки

Классическая компьютерная обработка изображений использует сложные алгоритмы, созданные при помощи традиционного программного обеспечения. Эти алгоритмы чрезвычайно сложны. Как говорилось выше, совсем недавно дипфейки представляли собой контролируемую модель, которой управляют разработчики. Подавляющее большинство элементом артикуляционной мимики жестко прописывалось в алгоритмах.

Правда, для того, чтобы создать убедительный дипфейк, требуются большие объемы видео, статические изображения, голосовые записи, а иногда даже сканирование головы реального актера с последующим анализом в качестве обучающих вводных данных. Например, клиенты Synthesia в течение примерно 40 минут снимают на видео, как они зачитывают заранее подготовленную речь, чтобы потом этот контент использовался для обучения нейронными сетями.

Несмотря на весьма впечатляющие результаты, дипфейки, создаваемые ИИ, не являются идеальными. У дипфейков есть ряд хорошо заметных (не для человека, для специализированного ПО) признаков, которые пока еще позволяют отличить реальность от вымысла. Это, например, нюансы освещения и теней, мигание, артикуляция, выражение и тон голоса. Для создания убедительного дипфейка все это нужно правильно комбинировать.

Изображения и видео

Достаточно часть в этом направлении используется Variational Autoencoder – VAE. Это генеративная модель, которая находит применение во многих областях исследований: от генерации новых человеческих лиц до создания полностью искусственной музыки. Что касается видео, то VAE позволяет достаточно быстро перенести особенности мимики и артикуляции определенного человека на сформированную объемную модель. VAE используется достаточно давно, но дипфейк, созданный при помощи этой технологии, несложно выявить.

А вот с 2017 года развиваются генеративные состязательные сети (GAN). Здесь в единое целое объединены, по сути, две нейронные сети. Одна, «дискриминатор», определяет реалистичность модели, созданной другой нейросетью. На выходе получается модель, которая была «одобрена» и является наиболее реалистичной.

Что дальше?

Дипфейки также поднимают множество вопросов о том, кому какой контент принадлежит, что делать с лицензиями и как наказывать нарушителей. Так, уже сейчас актеры заключают контракты с компаниями, разрешая использовать их образ и голос в рекламе или фильмах. Но, вероятно, некоторые компании будут использовать дипфейки знаменитостей в своих целях без всяких разрешений.

Deepfakes и deep media: Новое поле битвы за безопасность

Эта статья является частью специального выпуска VB. Читайте полную серию здесь: AI and Security.

Предвосхищая такого рода новую реальность, объединение академических учреждений, технологических фирм и некоммерческих организаций разрабатывает способы выявления вводящих в заблуждение медиа, генерируемых ИИ. Их работа показывает, что инструменты обнаружения являются лишь краткосрочным жизнеспособным решением, в то время как дипфейковая гонка вооружений только начинается.

Дипфейковый текст

Выше: Фронтенд GPT-2, обученной языковой модели исследовательской фирмы OpenAI.

Изображение предоставлено: OpenAI

В поисках системы, способной обнаруживать синтетическое содержимое, исследователи Школы компьютерных наук и инженерии имени Пола Г. Аллена Университета Вашингтона и Института искусственного интеллекта имени Аллена разработали Grover – алгоритм, который, как они утверждают, смог отобрать 92% дипфейков в тестовом наборе, составленном из открытых данных Common Crawl Corpus. Команда объясняет свой успех копирайтинговым подходом, который, по их словам, помог разобраться с особенностями языка, созданного ИИ.

Команда ученых из Гарварда и MIT-IBM Watson AI Lab отдельно выпустила The Giant Language Model Test Room, веб-среду, которая пытается определить, был ли текст написан с помощью модели ИИ. Учитывая семантический контекст, она предсказывает, какие слова наиболее вероятно появятся в предложении, по сути, написав свой собственный текст. Если слова в проверяемом образце соответствуют 10, 100 или 1000 наиболее вероятных слов, индикатор становится зеленым, желтым или красным соответственно. Фактически она использует свой собственный прогнозируемый текст в качестве ориентира для выявления искусственно сгенерированного контента.

Дипфейковые видео

Современный ИИ, генерирующий видео, так же опасен и обладает такими же, если не большими, возможностями, как и его естественный аналог. В академической статье, опубликованной гонконгским стартапом SenseTime, Технологическим университетом Наньянга и Институтом автоматизации Китайской академии наук, подробно описывается фреймворк, который редактирует отснятый материал с использованием аудио для синтеза реалистичных видео. А исследователи из Hyperconnect в Сеуле недавно разработали инструмент MarioNETte, который может управлять чертами лица исторического деятеля, политика или генерального директора, синтезируя лицо, оживленное движениями другого человека.

Однако даже самые реалистичные дипфейки содержат артефакты, которые их и выдают. «Дипфейки, созданные генеративными системами, изучают набор реальных изображений в видео, к которым вы добавляете новые изображения, а затем генерируют новое видео с новыми изображениями», – говорит Ишай Розенберг, руководитель группы глубокого обучения в компании по кибербезопасности Deep Instinct. «Полученное видео в результате немного отличается, поскольку происходят изменения в распределении искусственно генерируемых данных и в распределении данных в исходном видео. Эти так называемые «проблески в матрице», – то, что способны различать дипфейковые детекторы».

Выше: два фальшивых видео, созданных с использованием самых современных методов.

Изображение предоставлено: SenseTime

Прошлым летом команда из Калифорнийского университета в Беркли и Университета Южной Калифорнии подготовила модель для поиска точных «единиц действия лица» – данных о движениях лиц людей, тиках и выражениях, в том числе при поднятии верхней губы и вращении головы, когда люди хмурятся, – чтобы определить фальшивые видео с точностью более 90%. Аналогичным образом, в августе 2018 года участники программы «Медиа-криминалистика» Агентства перспективных исследований в области обороны США (DARPA) протестировали системы, способные обнаруживать видео, сгенерированное ИИ, по таким признакам, как неестественное мигание, странные движения головой, необычный цвет глаз и многое другое.

В настоящее время несколько стартапов находятся в процессе коммерциализации похожих инструментов для обнаружения поддельных видеоизображений. Амстердамская лаборатория Deeptrace Labs предлагает набор средств для мониторинга, целью которых является классификация дипфейков, загружаемых в социальные сети, платформы видеохостинга и дезинформационные сети. Dessa предложила методы улучшения детекторов подделок, обученных на наборах фальшивых видео. А в июле 2018 года компания Truepic привлекла 8 млн. долл. США для финансирования своего сервиса по глубокому обнаружению подделок на видео и фото. В декабре 2018 года компания приобрела стартап Fourandsix, чей детектор поддельных изображений получил лицензию DARPA.

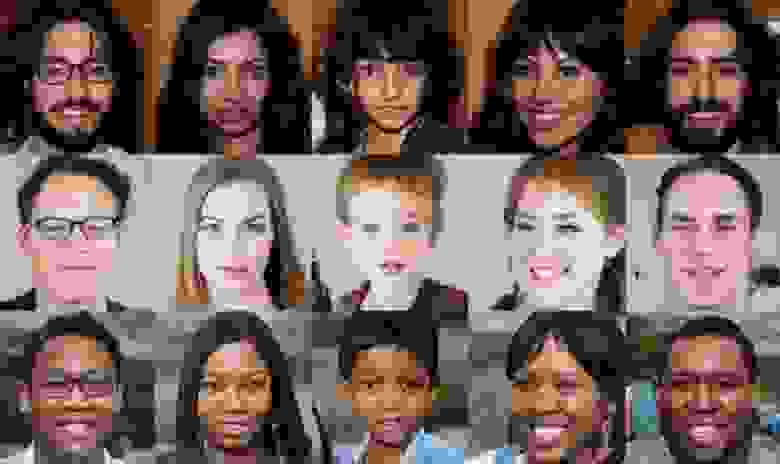

Выше: Дипфейковые изображения, отредактированные ИИ.

Помимо разработки полностью обученных систем, ряд компаний опубликовал корпусы текстов в надежде на то, что исследовательское сообщество разработает новые методы обнаружения подделок. Чтобы ускорить этот процесс, Facebook наряду с Amazon Web Services (AWS), объединением Partnership on AI и учеными из ряда университетов возглавил Deepfake Detection Challenge. Программа имеет набор образцов видео с метками, указывающими на то, что на какие-то из них воздействовали с помощью искусственного интеллекта. В сентябре 2019 года компания Google выпустила коллекцию визуальных подделок в рамках теста FaceForensics, который был создан Техническим университетом Мюнхена и Неаполитанским университетом Федерико II. А совсем недавно исследователи из SenseTime совместно с Технологическим университетом Наньяна в Сингапуре разработали DeeperForensics-1.0, набор данных для обнаружения подделок лица, который, как они утверждают, является самым большим в своем роде.

Дипфейковые аудио

ИИ и машинное обучение подходят не только для синтеза видео и текста, они также могут копировать голоса. Бесчисленные исследования показали, что небольшой набор данных – это все, что требуется для воссоздания речи человека. Коммерческим системам, таким как Resemble и Lyrebird, для этого требуется несколько минут аудиозаписей, в то время как сложные модели, такие как новейшая реализация Baidu Deep Voice, могут скопировать голос всего лишь с 3,7-секундного образца.

Инструментов для обнаружения аудиодипфейков пока не так много, но решения начинают появляться.

Несколько месяцев назад команда Resemble выпустила инструмент с открытым исходным кодом под названием Resemblyzer, который использует ИИ и машинное обучение для обнаружения дипфейков путем получения голосовых образцов высокого уровня и прогнозирования того, являются ли они реальными или смоделированными. Получив аудиофайл с речью, он создает математическое представление, суммирующее характеристики записанного голоса. Это позволяет разработчикам сравнить схожесть двух голосов или выяснить, кто говорит в данный момент.

В январе 2019 года в рамках Google News Initiative компания Google выпустила корпус речи, содержащий «тысячи» фраз, произнесенных с помощью моделей text-to-speech. Образцы были взяты из английских статей, прочитанных 68-ю различными синтетическими голосами на разных диалектах. Корпус доступен для всех участников ASVspoof 2019, конкурса, целью которого является содействие контрмерам против поддельной речи.

Многое можно потерять

Ни один детектор не достиг идеальной точности, и исследователи еще не выяснили, как определить фальшивое авторство. Розенберг из Deep Instinct ожидает, что это воодушевит плохих актеров на распространение подделок. «Даже если дипфейк, созданный злоумышленником, обнаружат, только сам дипфейк рискует быть раскрытым», – сказал он. «Для актера риск быть пойманным минимален, поэтому существует мало сдерживающих факторов против создания подделок.»

Теория Розенберга подтверждается отчетом Deeptrace, который нашел 14 698 фальшивых видео онлайн во время своего последнего подсчета в июне и июле 2019 года. За семимесячный период их количество увеличилось на 84%. Подавляющее большинство из них (96%) – видео порнографического содержания с участием женщин.

Учитывая эти цифры, Розенберг утверждает, что компании, которые «многое могут потерять» из-за дипфейков, должны разработать и внедрить в свои продукты технологию глубокого обнаружения, близкую, по его мнению, к антивирусным программам. И в этой области появились подвижки; в начале января Facebook объявил, что будет использовать комбинацию автоматизированных и ручных систем для обнаружения поддельного контента, а Twitter недавно предложил отмечать дипфейки и удалять те, которые могут причинить вред.

Конечно, технологии, лежащие в основе генерации дипфейков, являются всего лишь инструментами, и у них огромный потенциал для добрых дел. Майкл Клозер, глава отдела Data & Trust в консалтинговой компании Access Partnership, отмечает, что технология уже используется для улучшения медицинской диагностики и выявления рака, устранения пробелов в картировании вселенной и улучшения обучения беспилотных автомобилей. Поэтому он предостерегает от применения общих кампаний по блокировке генеративного ИИ.

«Так как лидеры начали применять существующие правовые нормы в делах о дипфейках, сейчас очень важно не избавиться от ценных технологий, избавляясь от подделок», – сообщил Клозер. «В конечном счете, прецедентное право и социальные нормы в отношении использования этой новой технологии не созрели достаточно, чтобы создать ярко-красные линии, разграничивающие добросовестное использование и злоупотребление».